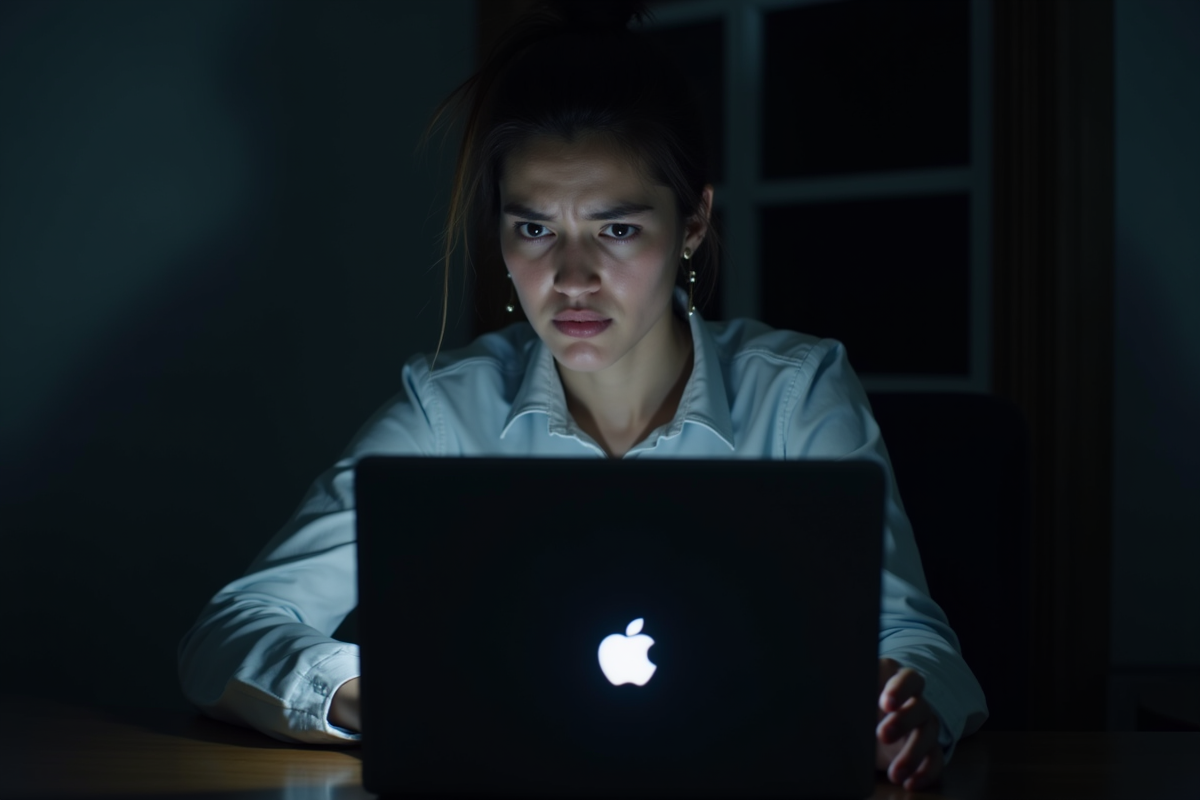

Les récentes avancées en intelligence artificielle suscitent autant de fascination que de peur parmi les utilisateurs. L’idée qu’une machine puisse apprendre, s’adapter et même surpasser les capacités humaines dans certains domaines ouvre des perspectives vertigineuses, mais elle soulève aussi des inquiétudes.

L’un des aspects les plus troublants est la perte de contrôle potentielle. Beaucoup craignent que ces technologies, en évoluant de façon autonome, échappent à notre gouvernance. La collecte massive de données personnelles et l’usage opaque de celles-ci alimentent les angoisses sur la confidentialité et la sécurité. Ces préoccupations, bien que souvent jugées alarmistes, n’en demeurent pas moins légitimes.

Les risques pour la vie privée et la sécurité

Les préoccupations autour de l’intelligence artificielle se concentrent sur les risques pour la vie privée et la sécurité. La collecte et l’utilisation des données personnelles par les systèmes d’IA posent des questions éthiques et juridiques majeures. L’Université de Zurich a mené une expérience secrète en utilisant des chatbots IA sur le subreddit r/changemyview de Reddit, soulevant des inquiétudes sur la manipulation et l’exploitation des opinions des utilisateurs.

Ben Lee, travaillant pour Reddit, a annoncé que la plateforme envisageait des poursuites judiciaires contre l’université. Cette affaire illustre les tensions croissantes entre la recherche en IA et la protection des droits des utilisateurs. Lewis Griffin de l’University College London a compilé une liste de 20 activités illégales perpétrées par IA, mettant en lumière les dérives potentielles de cette technologie.

Le déploiement de la reconnaissance faciale, souvent sans consentement explicite, exacerbe ces préoccupations. Les systèmes de surveillance basés sur l’IA peuvent identifier et suivre les individus, menaçant leur anonymat et leur sécurité. La société Compilatio, qui emploie Benoit Arpin, propose des solutions pour détecter l’utilisation de l’IA dans la génération de texte. Benoit Arpin explique que Compilatio Magister+ repose sur un algorithme qui délivre un pourcentage d’utilisation de l’IA et de similarité.

- Collecte massive de données personnelles

- Manipulation des opinions des utilisateurs

- Reconnaissance faciale et surveillance

La complexité croissante des systèmes d’IA et leur intégration dans divers secteurs exigent une vigilance accrue. Les utilisateurs, souvent mal informés, deviennent des cibles faciles pour des utilisations malveillantes ou non éthiques de leurs données.

La perte de contrôle et l’autonomie des machines

La crainte de la perte de contrôle sur les machines autonomes est fondée sur des exemples concrets. Netflix, par exemple, teste actuellement une interface d’intelligence artificielle générative dans son menu. Cette technologie permet aux abonnés de décrire en langage courant le programme qu’ils recherchent. Elizabeth Stone, qui travaille pour Netflix, explique que l’objectif est de permettre aux utilisateurs de découvrir des émissions ou des films en utilisant des phrases de conversation.

Cette nouveauté, en phase de test, est disponible uniquement sur le système d’exploitation d’Apple, l’iOS. Netflix va interpréter divers signaux, comme les bandes-annonces visionnées ou les recherches effectuées, pour personnaliser en temps réel les contenus suggérés. Cette initiative soulève des questions sur la capacité des utilisateurs à contrôler cette technologie et sur la frontière entre assistance et intrusion.

La prolifération des systèmes d’IA intelligents et autonomes dans divers secteurs renforce ces préoccupations. Apple, par exemple, collabore avec Netflix pour tester ces innovations. L’intégration de l’intelligence artificielle dans des applications courantes transforme la manière dont les utilisateurs interagissent avec la technologie, mais aussi leur rapport à la confidentialité et à la sécurité.

- Technologie générative d’IA

- Personnalisation en temps réel

- Collaboration entre géants de la tech

Considérez que cette évolution rapide des capacités des machines autonomes pose des défis éthiques et technologiques. La nécessité de réguler et de surveiller ces systèmes devient fondamentale pour éviter des dérives involontaires ou malveillantes.

Les biais et discriminations algorithmiques

Les biais et discriminations algorithmiques représentent une menace sérieuse dans l’usage de l’intelligence artificielle. Prenons l’exemple d’Aaron Wang, employé chez Apriora, une entreprise qui développe un système de recrutement basé sur l’IA. Ce système, censé objectiver le processus de sélection, a révélé des préjugés implicites dans ses décisions, perpétuant ainsi des discriminations.

Dans un autre cas, Ken a vécu une expérience troublante lors d’un entretien d’embauche entièrement conduit par une IA. Cette situation souligne les dérives potentielles de la technologie lorsqu’elle est utilisée sans supervision humaine adéquate. Les algorithmes peuvent reproduire et même amplifier les biais présents dans les données utilisées pour les entraîner.

Exemples concrets de biais

- Apriora : Développement d’un système de recrutement biaisé.

- Ken : Entretien d’embauche discriminatoire via IA.

Ces exemples illustrent les défis éthiques et sociaux posés par l’utilisation de l’intelligence artificielle dans les ressources humaines. Le recours à des algorithmes doit être accompagné d’une vigilance accrue pour identifier et corriger les biais afin de garantir une équité et une neutralité dans les décisions prises par ces systèmes.

L’impact psychologique et social

L’intelligence artificielle influe profondément sur notre psyché et nos interactions sociales. La sophistication croissante des chatbots et des assistants virtuels suscite des interrogations sur leurs effets. L’Université de Zurich a mené une expérience secrète en utilisant des chatbots IA sur le subreddit r/changemyview de Reddit. Cette initiative a révélé que les utilisateurs peuvent être manipulés sans en être conscients, exacerbant ainsi la méfiance envers ces outils.

Ben Lee de Reddit a annoncé que la plateforme envisageait des poursuites judiciaires contre l’Université de Zurich pour cette expérimentation non autorisée. L’introduction de l’IA dans les réseaux sociaux et autres plateformes en ligne soulève des questions sur la manipulation de l’opinion publique et la création de bulles informationnelles.

Au-delà des réseaux sociaux, l’impact psychologique de l’IA se manifeste aussi dans la sphère professionnelle. Ken, ayant vécu une expérience troublante lors d’un entretien d’embauche avec une IA, incarne les inquiétudes croissantes liées à la déshumanisation des processus de recrutement. La froideur des décisions algorithmiques et l’absence d’interactions humaines peuvent générer un sentiment d’aliénation chez les candidats.

Lewis Griffin, de l’University College London, a compilé une liste de 20 activités illégales perpétrées par IA. Cette compilation met en lumière les risques sociétaux, notamment l’utilisation de l’IA pour des activités malveillantes. Les utilisateurs, conscients de ces dérives, développent une méfiance accrue envers cette technologie, perçue comme une menace potentielle pour leur sécurité et leur bien-être.